「AIロボットが、たった15分でクラウン形成をした。」

そんなニュースが飛び込んできました。

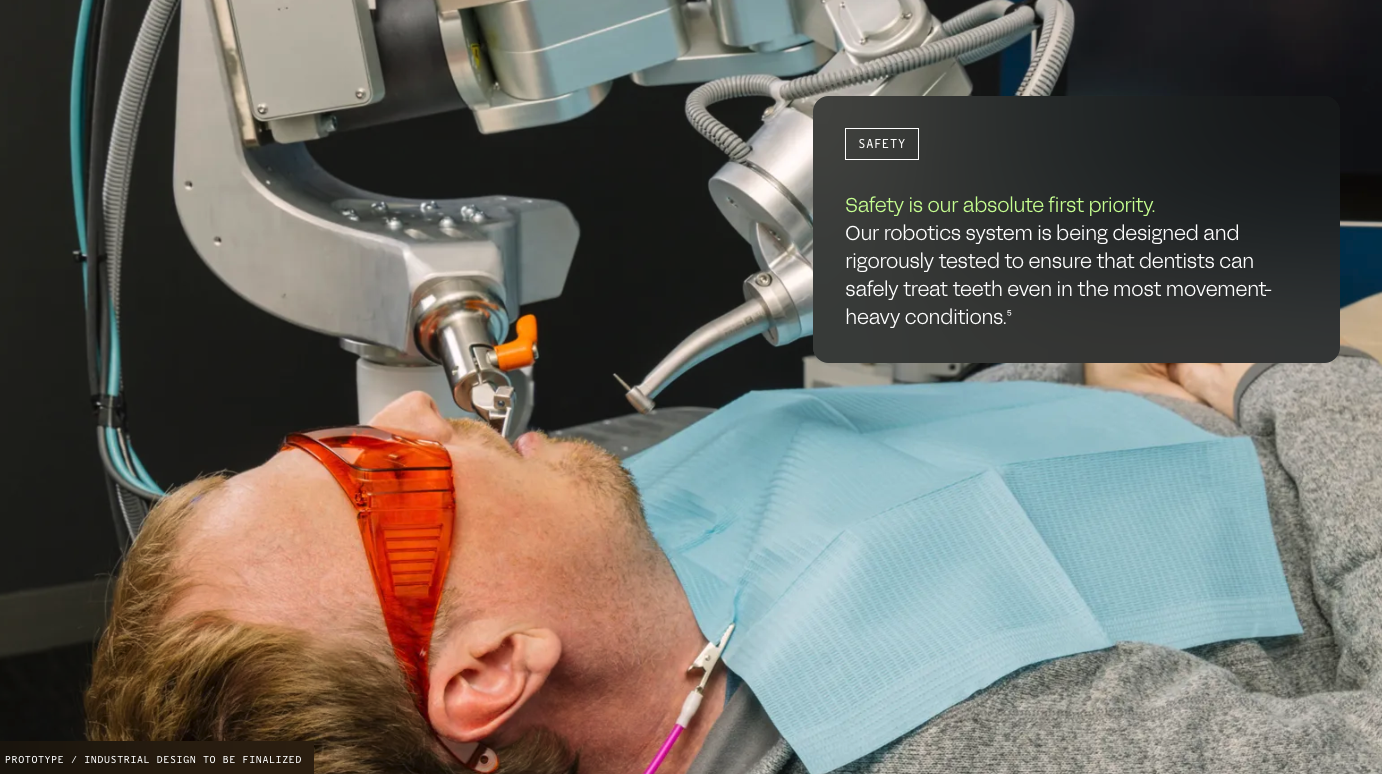

Perceptive(パーセプティブ)という米国の会社が開発した自律型歯科ロボット。2026年1月、査読済みの学術誌にも掲載されました。本物の話です。

いやいや、正直に言います。この動画を見て、歯科医として、ちょっとドキッとしました。

Perceptiveって、どんなロボットなの?

3つの技術が組み合わさっています。

まず「OCTスキャナー」。放射線を使わずに、光で歯の3Dデータを取る装置です。歯ぐきの下まで見えます。虫歯の検出精度が90%というのは、従来のX線(約45%)の2倍。

次にそのデータをAIが解析して、治療計画を自動で立てる。

そして精密ロボットアームが、0.05ミリ以下の誤差で削る。

これが「15分でクラウン形成」の正体です。患者さんは処置中も不快感なし。30分後には通常通りの生活に戻れた、と報告されています。

ただし——まだFDAの承認は取れていません。2026年3月現在、米国でも商用化されていないプロトタイプ段階です。「未来が来た!」と言いたいところですが、「入口に立った」という段階。

人間の歯科医って、どこが大変なの?

せっかくなので、正直にお話しします。

歯を削る作業、外から見ると簡単そうに見えますよね?

違うんです。本当に。

まず「死角」の問題があります。前歯の隣の面——隣の歯の陰に入った部分——はほぼ直視できません。ミラーを使って、鏡ごしに見ながら削る。左右が逆になった映像の中で、繊細な操作をする。慣れても、慣れても、難しい。ロボットには「死角」という概念がないんです。

次にマージンライン。歯ぐきとの境目です。ここを削るとき、歯ぐきの下に入ることがあります。見えない。出血で視野が悪くなることもある。手は微細に揺れる。「歯肉縁下マージン」——これは新人歯科医にはまず無理な操作です。

そして「再現性」。同じ歯を、同じ角度で、同じ形で、同じ深さで削り続ける。人間にはこれが極めて難しい。

ここが、ロボットの最大の強みです。

特にブリッジ。複数の支台歯を完全に平行に削り揃えないといけない。「平行」って、感覚だけでは限界があるんです。ロボットには圧倒的に有利な作業です。

そういう意味では——「下手な歯科医よりは、きっとうまい。」本音を言うと、そう思います。

じゃあ、AIロボットは完璧なの?現時点での課題

いや、まだそうでもない。

動画を見ると、咬合面(噛む面)を削ったあと、バーの跡が残っているんです。面がフラットじゃない。

熟練した歯科医の仕上げと比べると、まだ差がある。

「完璧」とは言えません。でも「すごい入口に立った」——そう感じました。

「2時間 vs 15分」のカラクリ

ここで少し突っ込んでいいですか。

「人間の歯科医は2時間かかるのに、ロボットが15分で——」

いやいや、ちょっと待って。

私、15分でできますよ。

日本の歯科医なら、みんな15分でできます。

「えっ、2時間?途中でお茶でも飲んで休憩してるの?」ってなりますよ、正直。(笑)

これはアメリカの診療モデルを前提にした数字なんです。アメリカの歯科医は1日に診る患者さんの数が少なく、1人にたっぷり時間をかけるスタイル。だから「クラウン形成に2時間」が標準になる。

アメリカ基準で驚いているだけで、日本の歯科医からすると「普通」の話。

「15分でロボットがやった!」——その驚きの半分くらいは、実はアメリカの診療スタイルのせいです。そこ、ちゃんと言っておきたかった。

患者さんはロボット歯科をどう思う?

当時の調査によると——2018年に502名を対象にしたアンケートがあります。

「ロボット歯科医に抵抗がある」——51%がそう答えました。

半数以上が「ちょっと怖い」。

でも、「50%割引なら」という条件をつけると——クリーニングなどの非侵襲的な処置なら、83%が受け入れると答えた。

「安ければロボットでもいい」ということですね。

一方で、抜歯や根管治療などの処置については、割引があっても66%が「人間の歯科医がいい」と答えています。

怖い処置は、人間の手でやってほしい。そういう感覚は、とても自然だと思います。

患者さんの正直さが、アンケートから滲んでいますね。

ロボットはどこまで賢くなれるか

ChatGPTのような言語AIが、インターネット上の膨大な文字データで賢くなったように——ロボットは「現実世界の動作データ」で賢くなります。

これを「フィジカルAI」と言います。

NVIDIAのジェンセン・フアンが今年こう言いました。「ロボットのChatGPTモーメントが来た。」

Perceptiveがクラウン形成のデータを積み上げていけば、テスラの自動運転が走行距離で賢くなっていったのと同じ原理で、精度は上がっていく。

バーの跡が残る?面がフラット?それは今の話です。

もう一つ、面白い未来もあります。AIグラスをかけた歯科医が、3Dのガイドラインを見ながら削る。「ここまで」「この角度で」という情報が目の前に浮かぶ。ロボットと人間の融合みたいな形。

それも、そう遠くないかもしれません。

ロボットが来ても、変わらないもの

道具は進化します。X線が来たとき、歯科は変わりました。CAD/CAMが来たとき、また変わりました。

ロボットが来ても、きっと変わる。

Perceptiveが商用化される日が来たら——たぶん私も使うと思います。道具として。(値段によるけどね。なんなら自分で開発したいくらい。)

ただ、何が変わらないかというと——

削る前に「大丈夫ですよ」と声をかけられること。「今日、調子はどうですか?」と聞けること。怖い顔をして来た患者さんが、ちょっとほぐれる瞬間を作れること。

それは、ロボットにはまだできません。

歯を診るより前に、人を診る。

その部分は、長年歯科医をやってきて、まだまだ道具に渡したくないなと思っています。

かみふさ歯科診療所副院長でした。